Futurra Group

We are an IT company with Ukrainian roots with Head offices in Cyprus and Hong Kong that builds mobile and web edtech products used and valued by millions of people worldwide.

We bring the strongest professionals together to change the future of EdTech.

> 60

people on team

100 M

users of our products

7 years

of experience in mobile & web development

Our products rank among the top in Tier-1 countries

(USA, Canada, UK, etc.)Musesacademy

Our lifestyle education platform for women, focused on personal development and empowerment. The platform offers tools and strategies to become proactive, reclaim feminine essence, and develop better communication skills.

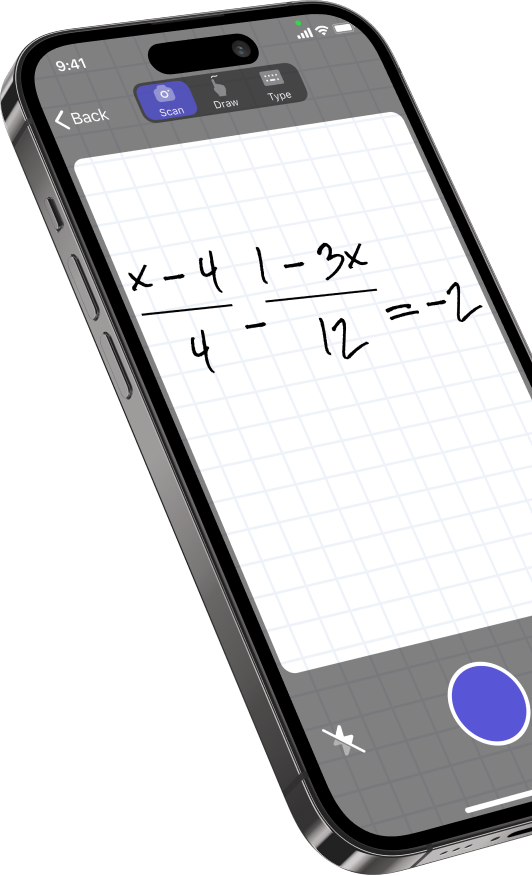

Our flagship app helps learners solve math problems of any complexity quickly and effectively through its algorithm for auto-recognition and an online chat with math experts.

Other Products

ScanMaster

SpeakMe

IronVPN

FaxMe

Scanner App

StarMaster

We are high-achievers who turn ideas into results

Our values

Proactivity is key

Embrace innovation, explore strategies, adapt frameworks. Each team member influences outcomes and takes ownership of decisions. It is the key to our constant growth.

Be the part of process

Immerse yourself in the processes in great detail to understand the big picture. We all passionately contribute to shared mission and never stand aside.

Go big or go home

We are all about dynamics and drive. We never settle for what's been achieved and always strive for more.

Be a lifetime learner

Self-motivation is the greatest driver of change. Never stop learning and proactively share acquired knowledge.

Aim for results

The Futurra team is focused on outcomes, not just processes. We believe that each result is achievable and find no satisfaction in the absence of results.

Teamwork makes the great work

In team we trust! Team is our greatest pride and most valuable asset. Finding our perfect match is always a worthwhile challenge.

Benefits

Non-bureaucratic environment

Your career growth directly depends on your results

Flexible schedule

Funding of specialized courses and trainings

Spacious office with terrace located 2 min.from Poshtova Square

Corporate events and sports

Free breakfasts, lunches, and fruits